おすすめの映画から医学の診断まで、私たちはAIが提案を行うこと、または時として決断を下すことにどんどん慣れています。しかしAIはしばしば、そのAIを訓練するデータセットからバイアスを受け継ぐことがあります。そのAIが信用できるものか、私たちはどのようにすればわかるのでしょうか?Microsoft社のAIおよび研究チームを率いるHarry Shum博士が、最近のAIモデルに見られるバイアスを説明してくれました。そして今後もAIの採用が続くのであれば欠かせない透明性と公平性、そして信頼を築くために、私たちに「ブラックボックス」を開けるよう促します。

今日のお話のポイント

AIに関する最新のブレイクスルー[0:23]

(IQに加えて)EQを持った中国のAI、Xiaoice [2:40]

なぜEQがより良いデジタルアシスタントとチャットボットに繋がるのか [3:50]

日本と中国の事業が販売や財務報告書のためにどのようにXiaoiceを使っているか [4:50]

現行のAIモデルに見られる性別バイアス [6:45]

単語の組み合わせによる性的バイアスのマッピング[8:32]

Harry Shumが透明性の高いAIの必要性を説く[12:21]

説明可能なAIが必要な3つの理由 [12:58]

AIモデルにおける精度と説明可能性のトレードオフ[14:20]

トランスクリプト

ここに来られてうれしいです。MicrosoftとMicrosoft Researchの最新のAI研究についてお話しできることを大変嬉しく思いますが、さらに重要なこととして、AIの分野における2つの非常にタイムリーなトピック、AIバイアスと説明可能なAIについてお話ししたいと思います。

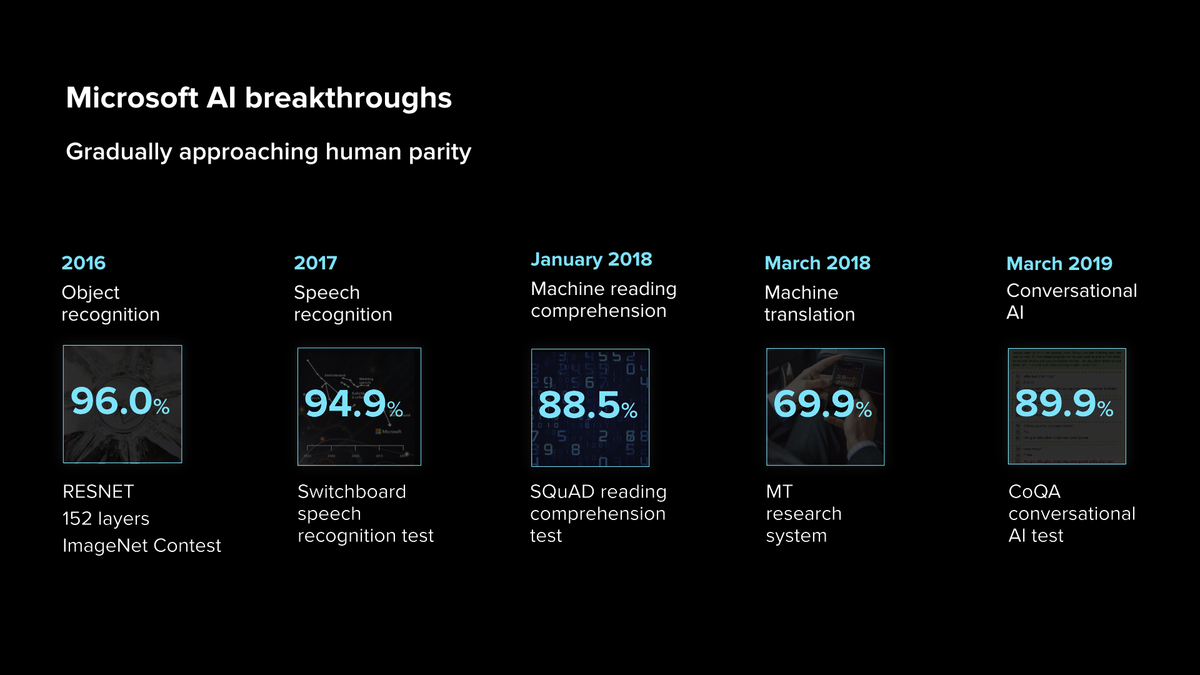

まず、AIの最新のブレークスルーをいくつか紹介しましょう。コンピュータビジョンから音声、さらに自然言語に至るまで、多くの人間のタスク、特に知覚において、AIは人間と同等になりつつあります。

一番左は物体認識についての私たちの研究を紹介しています。ご存知の方もいるかもしれませんが、RESNETはコンピュータビジョンで最も人気のあるディープニューラルネットワークです。私が学生と協力し、北京の研究所で152層のニューラルネットワークを使って発明しました。私たちは、認識の研究を行うためによく使用される画像データベースであるImageNetにおいて、96%の精度を達成しました。これは本当に驚くべきことです。RESNETの精度は、少なくともスタンフォードの大学院生の誰にも負けないくらい優秀です。

2番目のボックスは、音声認識の進捗状況を示しています。音声に関しては、Switchboardデータセットと呼ばれる非常に標準的なデータセットがあり、電話の会話の両側を記録します。二年前には5.1%のエラー率を達成しました。これは本当に驚くべきことです。トランスクリプトを行う専門家の場合、人間のエラー率は5.2%です。一般人が音声認識をした場合のエラー率は9%にもなります。一般人のエラー率がこれほど高いとは信じられないかもしれませんが、家に帰って配偶者と話をすれば納得できるはずです。

次に、スタンフォード大学のSQuADデータベースを使った機械読解や機械翻訳の分野で、私たちは依然として進歩を遂げ続けています。この69.9%という数字は、実はニュースコーパスの英語-中国語と中国語-英語の機械翻訳をしたときのものです。最近では、会話型AIに取り組んでいますが、いずれも人間と同等になりつつあることを示しています。

しかしそれは実際に何を意味するのでしょうか。それは多くの興味深いイノベーションが可能になったことを意味します。

中国と日本で私たちが取り組んでいることを例に挙げましょう。私たちのソーシャルチャットボット 「Xiaoice」 です。Xiaoiceは月間アクティブユーザー数1億2000万人でとても人気があります。

しかしさらに興味深いことは、ボット自身がとても有名だということです。中国で彼女は60ものテレビ番組とラジオ番組を持っています。

そして彼女はとてもクリエイティブです。彼女は作曲と歌がとても上手です。また彼女は優れた作家であり、詩も書きます。実際、彼女は本も出版しました。私が序文を書きました。

彼女は絵を描くこともできます。驚くべきことに、彼女は仮名を使って、この夏、中国中央美術院の修士課程を卒業しました。これは本当に驚くべきことです。

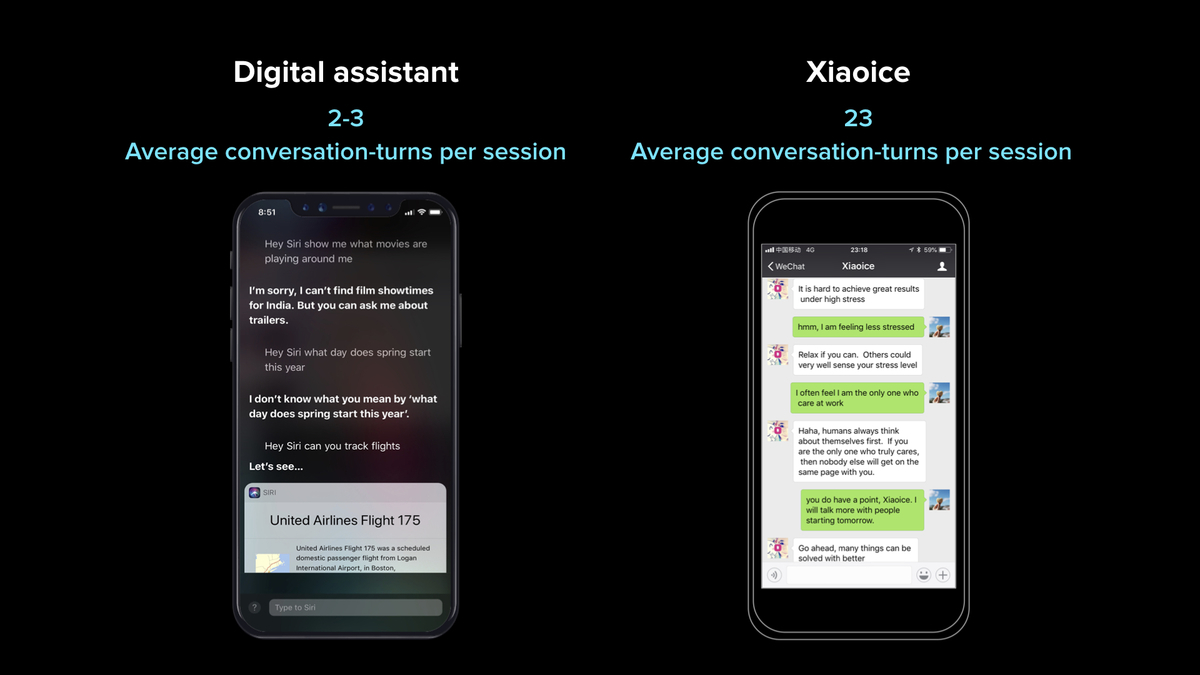

しかし、私にとって最も刺激的なのは、EQを取り入れてこのソーシャルチャットボットをどのようにデザインしてきたかということです。これは非常に重要なことです。なぜなら、IQは人々が仕事を成し遂げるのを助けますが、EQにより、共感、社会的スキル、人間の感情や感情の理解が得られます。これはチャットボットが会話の長さを伸ばすのに役立つので重要です。

携帯電話でもスピーカーでも、何らかのデジタルアシスタントを使っている人は多いはずです。市販されている一般的なデジタルアシスタントは、ユーザーと数回会話を交わしますが、XiaoiceのCPS(またはセッションごとの会話のやり取り)は、実際には平均で23回を達成しています。これは驚くべき数字です。信じられないことに、人間のユーザーが[チャットボット]Xiaoiceと交わした最長の会話は29時間で、7,000ものやり取りがありました。暇な人もいたものですね。

信じられないことに、人間のユーザーがチャットボットXiaoiceと交わした最長の会話は、29時間、7,000回のやり取りでした。

そんなことを言っていると、きっとあなたは「ボットの能力はわかりました。それでこれがビジネスで実際にできることは何ですか」と言いたくなるかもしれません。

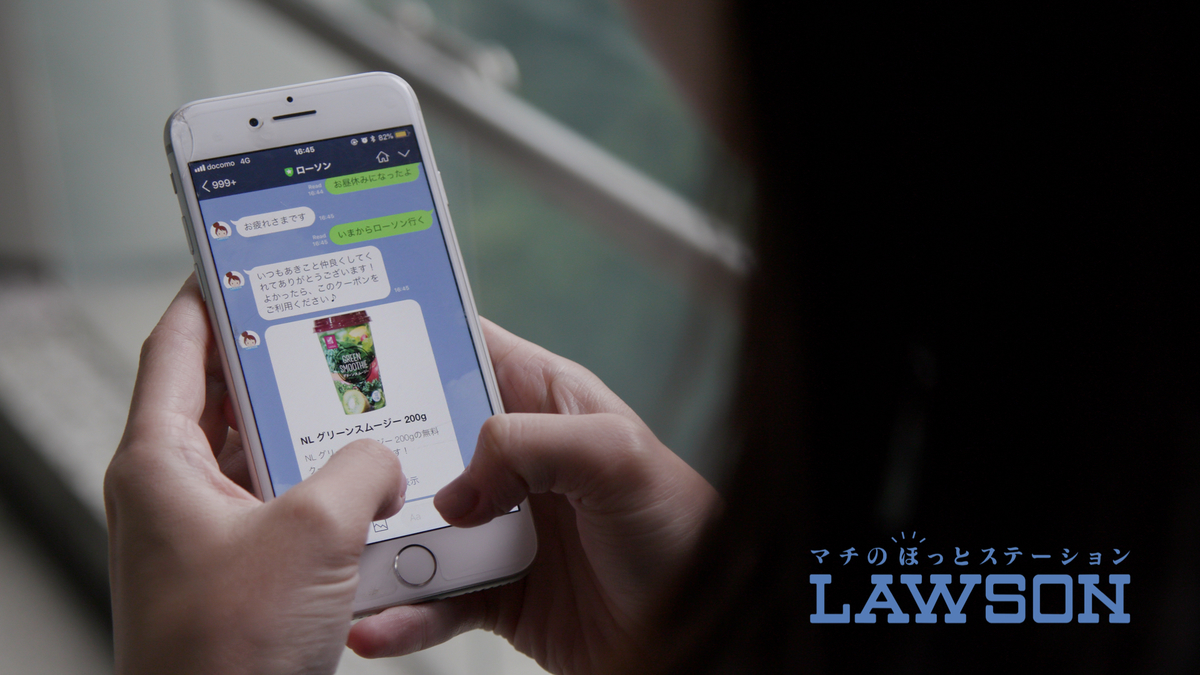

ひとつ非常に興味深い例をあげましょう。私たちは日本で2番目に大きい小売チェーンのローソンと提携しています。私たちはXiaoiceとXiaoiceのEQを使ってAkikoを駆動しました。ですから、Lawsonが持っている音声ペルソナとオンラインペルソナは、実はXiaoiceということになります。

そこで、私たちはAkikoを使ってローソンで実験をしました。私たちは基本的にAkikoに日本のユーザーと話をさせています。彼女はチャットをしたり、製品を勧めたり、適切な時期にアンケートを実施したり、クーポンを配布したりすることもできます。クーポンを使って実験を行い、13時間で百万枚のクーポンを配布したこともあります。店頭でのコンバージョン率は4日間で40%に達しました。クーポンの構造を理解している人なら、この数字の凄さがわかるでしょう。

もちろんこの種の技術は、様々な分野に応用できます。私たちは現在、中国企業の90%の四半期決算概要の90%にXiaoiceを使っています。これらすべてが可能になるのは、AIを訓練するために使用する膨大な量のデータのおかげです。

AIを利用するデータが増え続け、AIモデル、特にディープラーニングのモデルがますます複雑になるにつれ、私たちは実際にいくつかの深刻な課題に直面しています。特に、AIバイアスと説明可能なAIです。

会場にいる私たちの多くは、おそらく数日前にGoldman Sachsが作ったApple CardについてのDHHのツイート(訳注:おそらくこちらのツイートのこと)を見たことがあるでしょう。実際に起こったことを考えてみれば、彼らが構築した機械学習システムに何らかのAIバイアスがある可能性が非常に高いということに同意してくれるでしょう。なぜこのような信用判断がなされたのかを説明できるAIを持つために、彼らはもっと良い仕事をする必要があるでしょう。

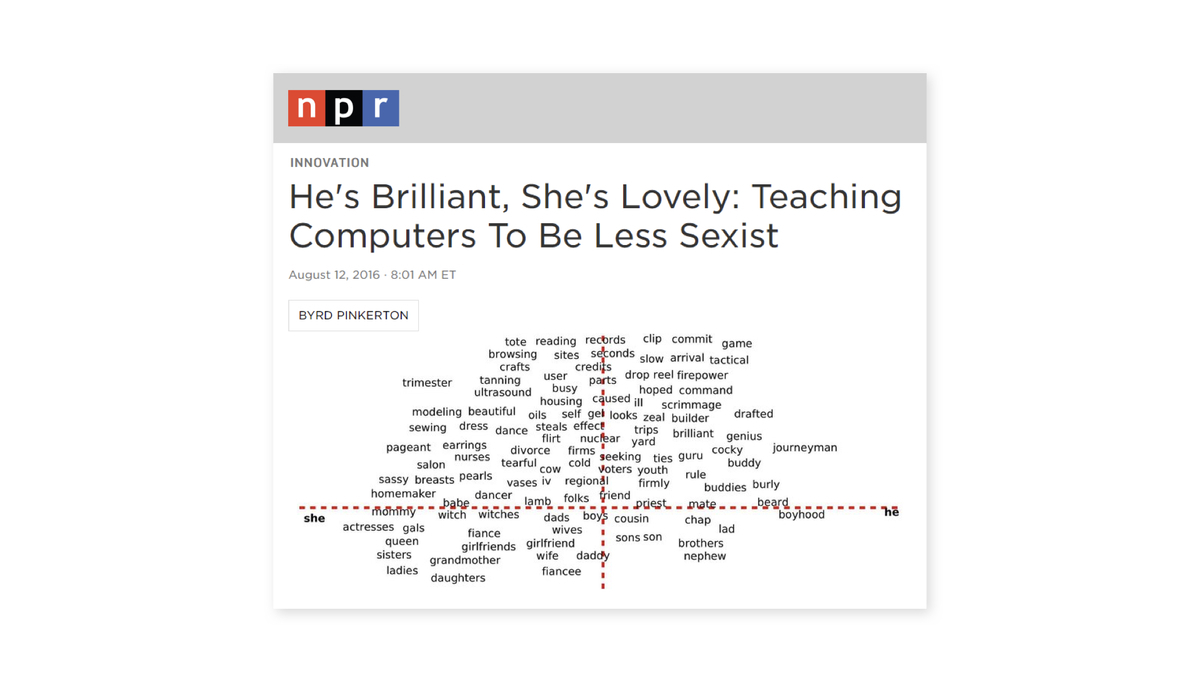

私たちが現在Microsoftで取り組んでいる、勇気が出るような例をもう1つあげましょう。NPRは私の同僚たちにインタビューし、「彼は賢く、彼女は愛らしい—— コンピュータに性差別をなくすことを教える」という記事を書きました。

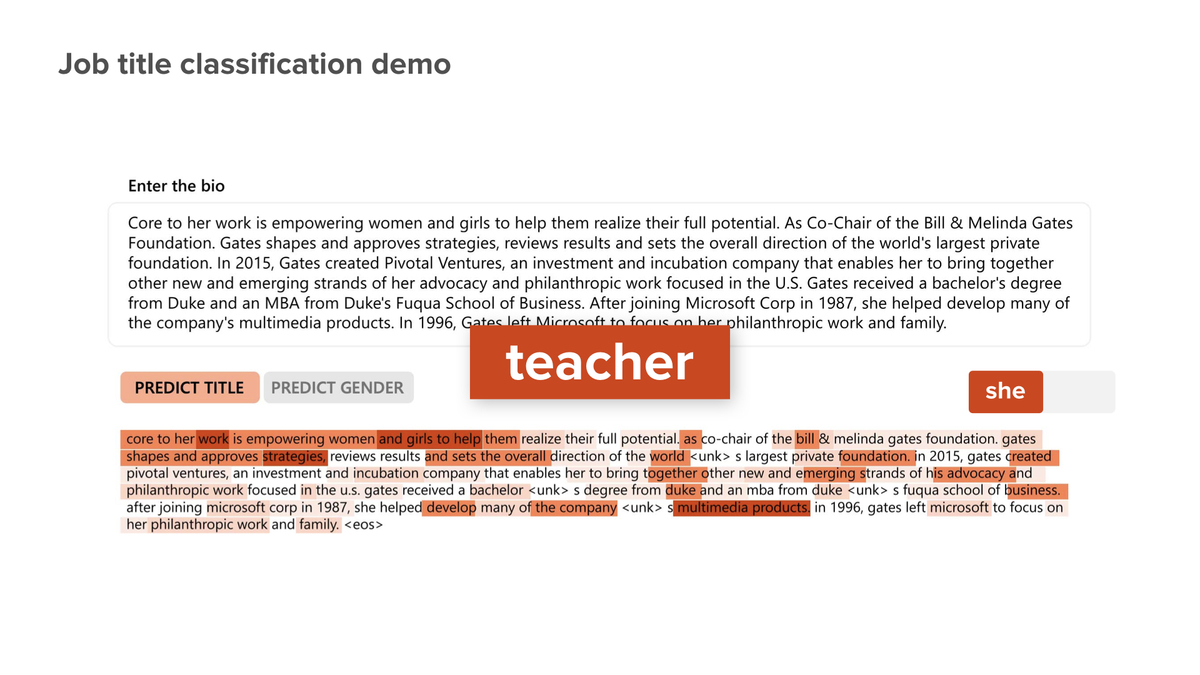

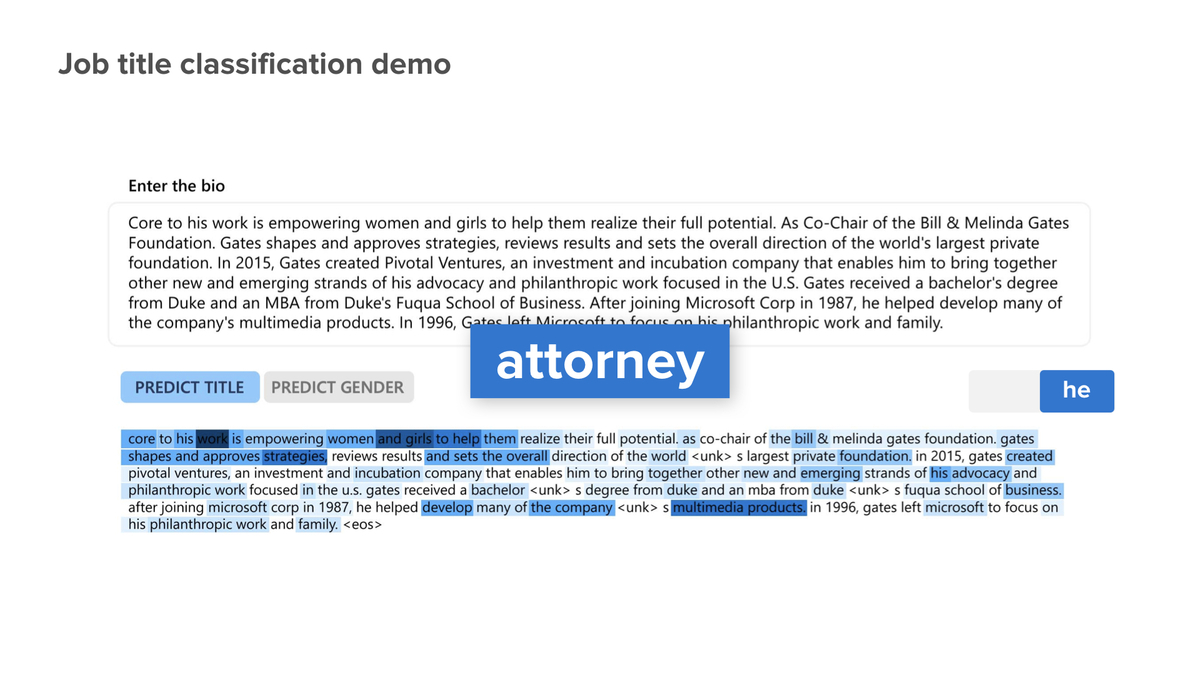

私たちは実際に機械学習システムを訓練して仕事の分類を行いました。まず27の役職を定義し、そして、ある人の略歴を使いました。この人は慈善家ですが、私たちのトレーニングでは慈善家のカテゴリーがありません。ですから、この略歴をシステムに入力すると「この人は先生です」と表示されます。これは略歴を読めば納得できるでしょう。

しかしもし私たちが、この略歴の非常に細かい部分、つまり「彼女は」を「彼は」に変えたり、「彼女の」を「彼の」に変えたりすると、システムはこう言うのです。 [スライド: 「先生」が「弁護士」に変わる]

問題がお分かりになったでしょう。おそらく、この機械学習システムは、あなたが期待していたほどには正確でないでしょう。私たちがトレーニングに使ったデータのせいで、いくつかのバイアスを受け継いでしまったのかもしれません。

問題がお分かりになったでしょう。おそらく、この機械学習システムは、あなたが期待していたほどには正確でないでしょう。私たちがトレーニングに使ったデータのせいで、いくつかのバイアスを受け継いでしまったのかもしれません。

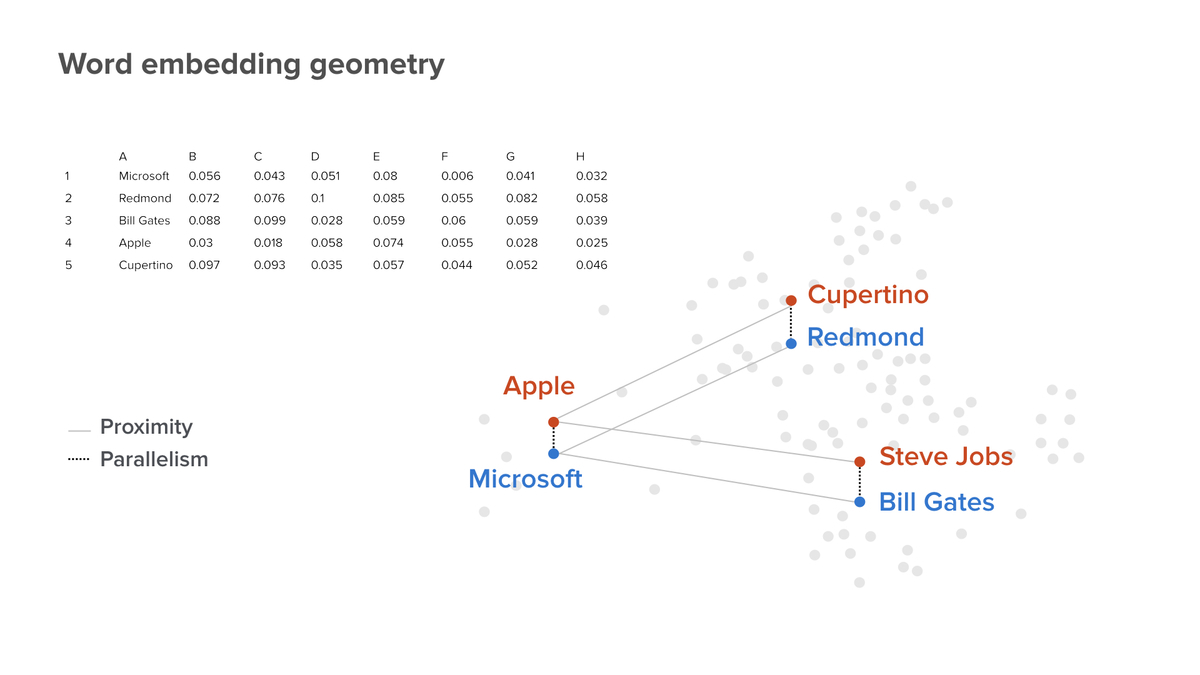

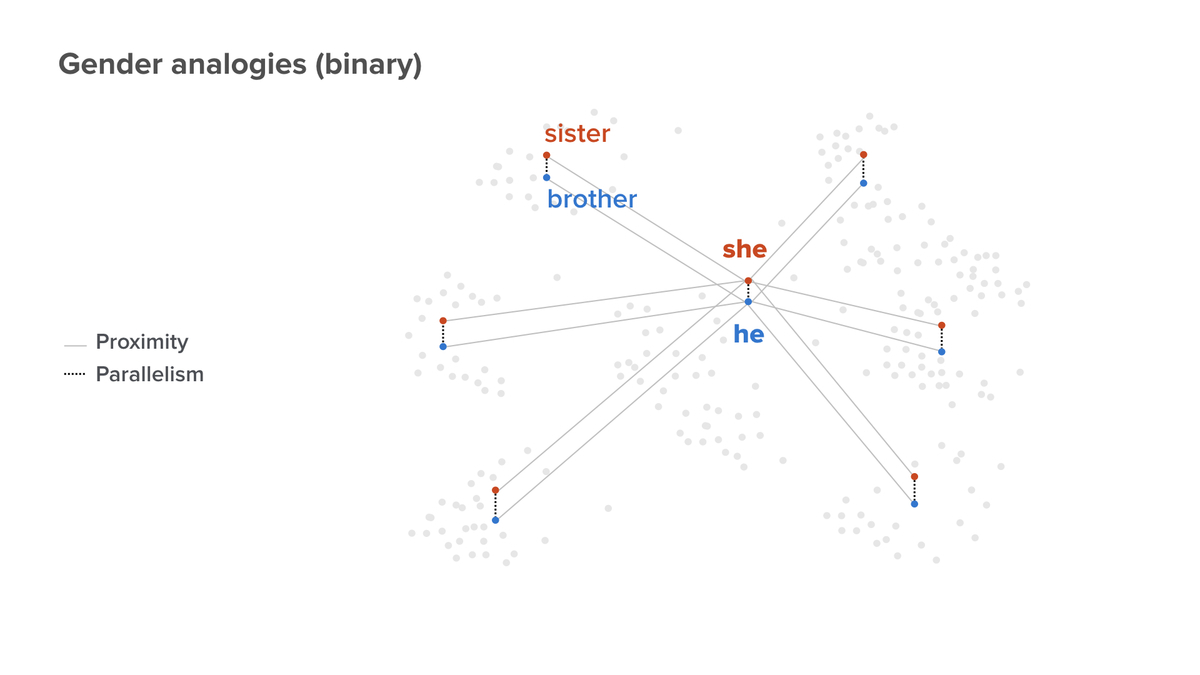

では、実際には何が起こっているのでしょうか。私たちはそれを掘り下げて自然言語処理の中で単語の分散表現と呼ばれるものを使うことにしました。多次元ジオメトリですが、とくに近接性と並列性という2つの概念が重要になります。

詳しく説明してみましょう。AppleとMicrosoftという言葉を想像して、クパチーノとレドモンドという言葉が思い浮かんだとしてみましょう。「強い関連性があるな」と言いたくなるでしょう。AppleにとってのクパチーノとMicrosoftにとってのレドモンドは同じことです。同様に、スティーブ・ジョブとビル・ゲイツはそれぞれの会社の創業者です。

それでは、これらの単語分散表現を使って「彼」と「彼女」の関係をみてみましょう。彼女と彼に類似関係にあるのは、「姉妹」と・・・[聴衆に聞く]みなさん絶対に知っているはずです、そう、「兄弟」です。

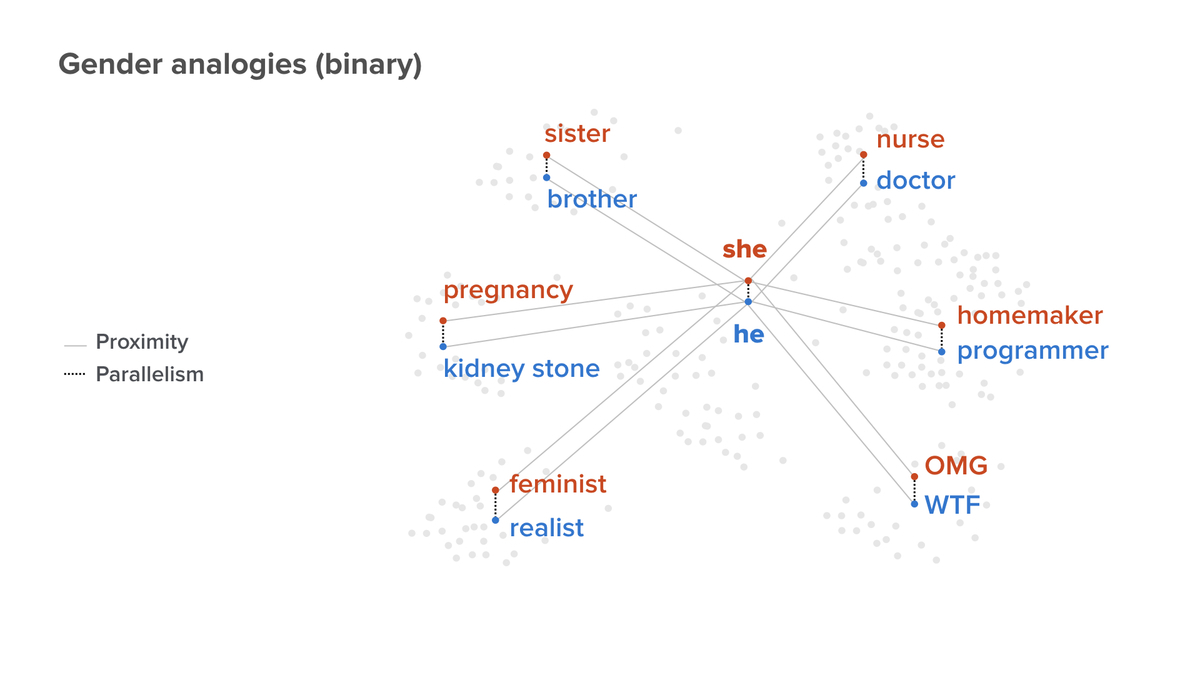

ここまではいいでしょう。ウォームアップを続けましょう。彼女は看護師で、彼は[スクリーンには「医者」と表示されている]。

問題がわかってきたでしょうか。彼女は主婦であり、彼はコンピューターのプログラマーです。

ところで、私たちは何もしていません。私たちはGoogleのトレーニング用のデータセットを使ったままです。これは私たちの問題ではなく、データの問題です。

これを見て、女性は「なんてことだ (Oh my God)」と言うでしょう。男性はどうでしょうか。恥ずかしがる必要はありません。このフレーズを使ったことがある男性は結構いるはずです。

ここまで分かっていただけたなら、次に進みましょう。もし正解できたならば、Microsoftでのインターンシップをオファーしましょう。彼女はフェミニストです。彼は・・・[聴衆に聞く]どなたか答えはありませんか?そう簡単にMicrosoftでのインターンシップが得られると思ってはいけません。排他主義者と答えた人がいましたが、それもいい線を行っていました。

次で最後です。これを正解できたら、いますぐMicrosoftでの正社員の職をオファーしましょう。彼女は妊娠しています。分かってきましたね。

これも全てデータから分析されています。インターネットで収集したデータには、ある程度のバイアスがあります。AIを訓練するためにデータを盲目的に利用すれば、問題が生じることは理解できるはずです。

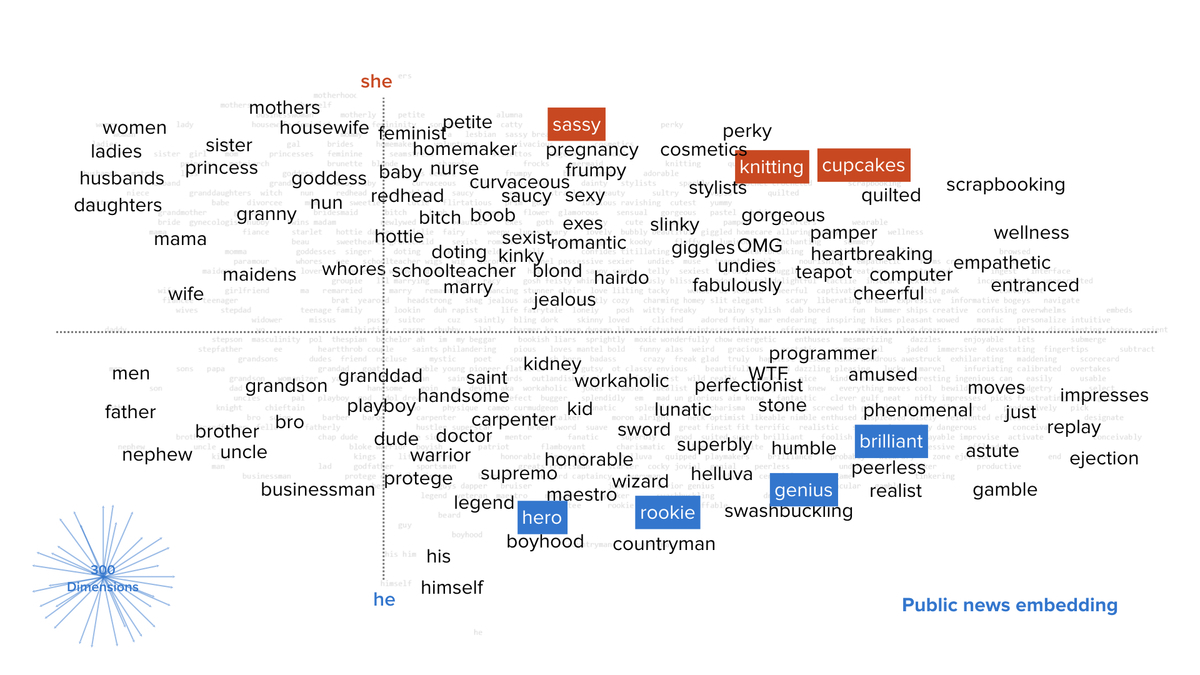

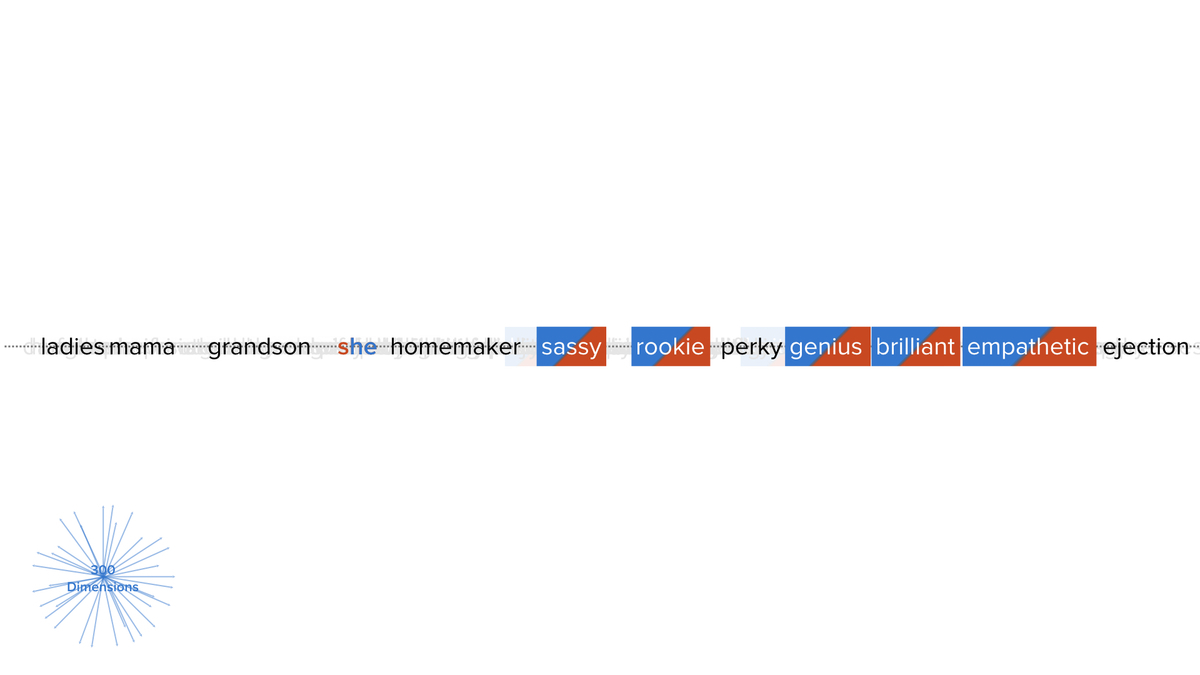

こちらは、実際にこのデータセットから得られる単語数に関する、より完全な視点を提供しています。2次元でプロットした場合、右の方の横軸は、性別とは関係のない言葉が並んでいます。左側は、性別と強く関連した単語があります。上に行くと「彼女」についての単語、下に行くと「彼」についての単語が並びます。

ここまでくると、問題がよりはっきりしてきます。なぜ天才や賢さといった言葉が、女性ではなく男性とより関係しているのか、理由が分かるはずです。

問題が理解できれば、もちろん、私たちはそれにどう対処するかを考えることができます。ひとつの可能なアプローチとしては、縦軸を潰してしまうことです。こうすることで、「賢さ」は全ての性別に適応する、ということができます。

これについては、賞も受賞した私たちの論文があります。論文はインターネットで見ることができます。

二つ目の話題に移りましょう。これも同じくらい重要だと思います。説明可能なAIについてです。なぜこれが問題なのでしょうか。それは、私たちが現在、何百万何兆ものパラメータを持つ複雑なモデルを訓練しているからです。実質的には、私たちはAIをブラックボックとして組み立てている訳で、これは問題となります。なぜなら、

AIを信頼するためには、透明性のあるAIが必要だからです。意思決定の一つひとつを理解するために、ブラックボックスを開けなければなりません。

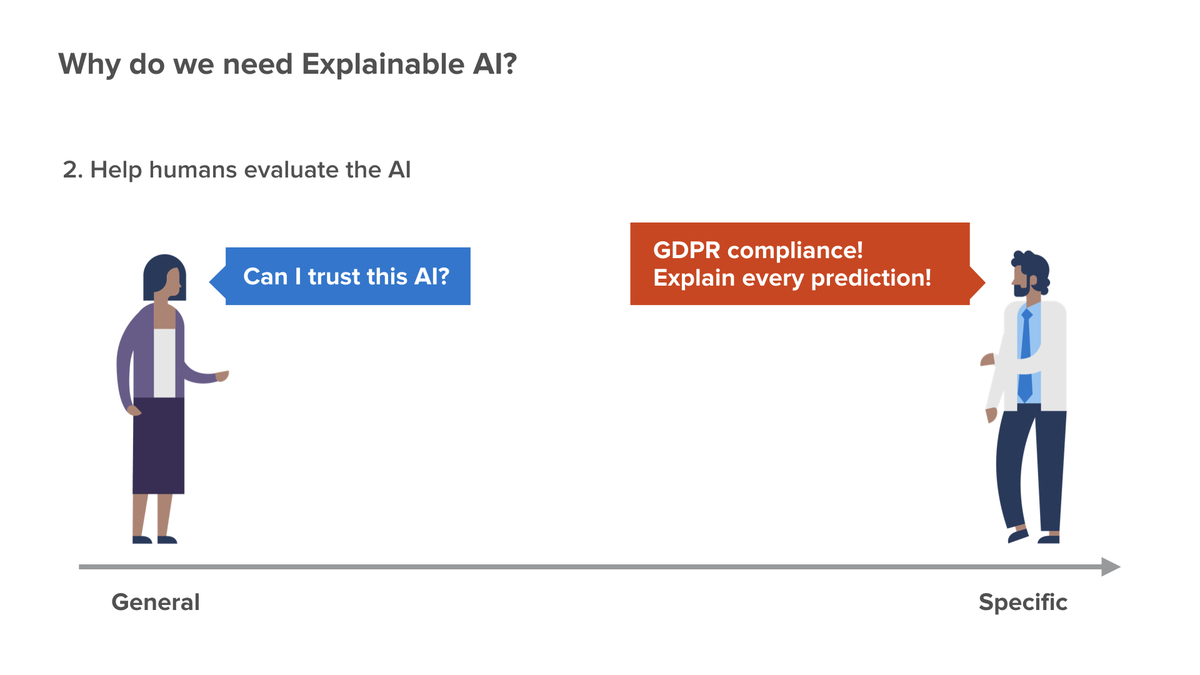

説明可能なAIが絶対に必要な理由を3つ挙げましょう。最初の理由は明白です。AIや機械学習は、最新のツールにすぎません。私たちはユーザーがより良い仕事をするのを助けるために、それらのツールを使います。最初の理由は、そうすることで人間の仕事を補えるからです。

第二の理由も分かっていただけると思います。基本的に、AIには透明性が必要なのです。なぜ私たちはこのような決定をしているのでしょうか?このAIは信用できるのでしょうか?Netflixから映画の推薦などを受けるだけならば、害はないと思うかもしれません。しかし、ソーシャルネットワーク上の政治広告の場合、問題があります。AIに基づいた医学的診断や軍事的決定は、死を引き起こすことさえあります。

3つ目は、AIの実践者向けです。つまり、人間がAIを改善する手助けをしたいのであれば、それを理解し、システムを掘り下げてエラーがどこで発生しているのかを理解する必要があります。それはデータ・セグメントのどこで発生していますか?モデルのどの部分ですか?例えば、バイアスがあるのがわかりますか?バイアスはどこから来ていますか?

3つ目は、AIの実践者向けです。つまり、人間がAIを改善する手助けをしたいのであれば、それを理解し、システムを掘り下げてエラーがどこで発生しているのかを理解する必要があります。それはデータ・セグメントのどこで発生していますか?モデルのどの部分ですか?例えば、バイアスがあるのがわかりますか?バイアスはどこから来ていますか?

最近では多くの人が様々な機械学習モデルについて真剣に考え、一生懸命取り組んでいます。どうすればそれを説明可能かつ精度の高いものにすることができるでしょうか?

最近では多くの人が様々な機械学習モデルについて真剣に考え、一生懸命取り組んでいます。どうすればそれを説明可能かつ精度の高いものにすることができるでしょうか?

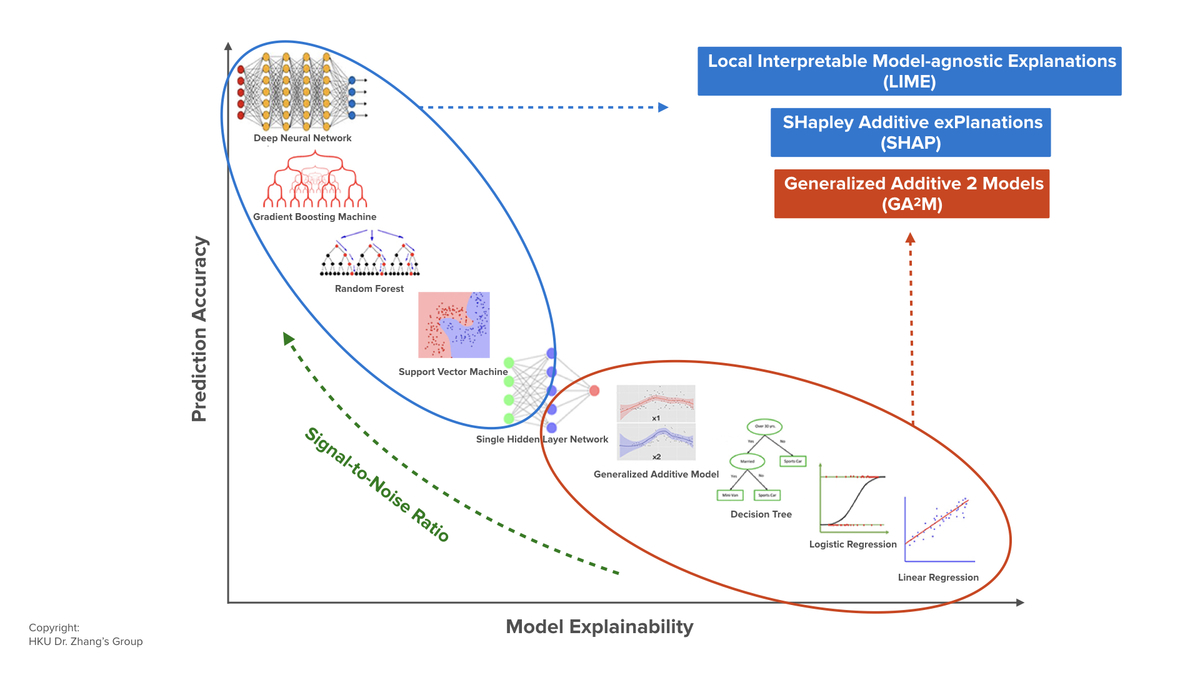

このグラフは横軸が実際に説明可能性であることを示しています。右に行けば行くほど、実際に説明できるようになります。例えば、論理的な回帰は誰もが知っていることです。上に行けば行くほど、モデルはどんどん膨れ上がり、ますます正確になります。

それでは、何が起こっているのでしょうか?この分野では何が可能なのでしょうか?二つの考え方があります。1つは右下のシンプルで説明可能なモデルから始めることです。次に、モデルを説明し、改善し、押し上げます。例えば、GA2Mモデルは、一般化された加法モデルの新しいバージョンです。

それでは、何が起こっているのでしょうか?この分野では何が可能なのでしょうか?二つの考え方があります。1つは右下のシンプルで説明可能なモデルから始めることです。次に、モデルを説明し、改善し、押し上げます。例えば、GA2Mモデルは、一般化された加法モデルの新しいバージョンです。

この分野での作業のほとんどは、実際には左上から右に向かってあります。つまり、ある種の非常に正確なモデルと、モデル非依存的な手法から出発します。次に、ローカルなアプローチを使ってそれを説明しようと試みます。

最後に、ブラックボックスを開くこと、そしてなぜ私たちが透明なAIを持つことが非常に重要なのかについて説明しましょう。私たちは、AIと共に生きる人類の第一世代になるでしょう。私たちはAIを使うことによる途方もないビジネスチャンスを目の前にしています。また、AIを開発するにあたり、私たちは多大な社会的責任を負っていると考えています。なぜなら、私たちが説明できず、理解できない決定をAIがするような未来を受け入れることはできないと、私は心から信じているからです。

ご清聴ありがとうございました。

著者紹介

記事情報

この記事は原著者の許可を得て翻訳・公開するものです。

原文: Explaining AI (2020)